Seedance 2.0を使い始めたいけれど、どこから手をつければいいかわからない。

そんな疑問を持つ方に向けて、この記事ではSeedance 2.0の使い方を基礎から徹底解説します。

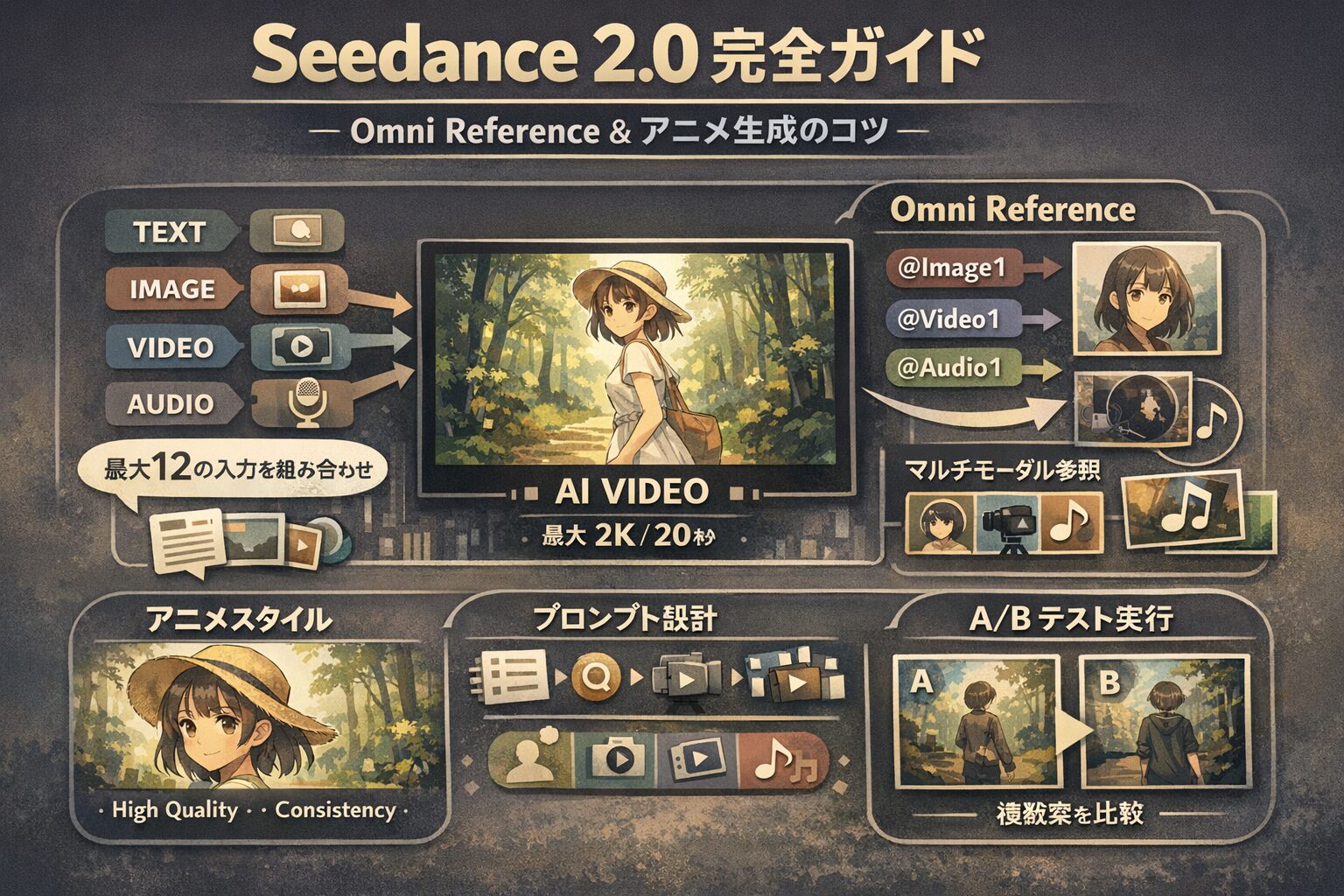

ByteDance(字節跳動)が2026年2月に正式リリースしたSeedance 2.0は、テキスト・画像・動画・音声の4種類の入力を組み合わせて、最大2K解像度・最長15〜20秒のAI動画を生成できる次世代モデルです。

とくに「Omni Reference(全方位リファレンス)」と呼ばれるマルチモーダル参照機能と、日本のアニメスタイルの動画生成に強みを持ち、AIクリエイター界隈で急速に注目を集めています。

この記事を最後まで読めば、Seedance 2.0の基本操作から、Omni Referenceを使った高度なプロンプト設計、アニメ動画を美しく生成するコツまで、一通りマスターできます。

Seedance 2.0とは?まず基本を整理しよう

ByteDanceが放つ次世代AI動画モデル

Seedance 2.0は、TikTokやDoubaoを擁するByteの技術部門「Seedチーム」が開発したAI動画生成モデルです。

前世代モデルから大きく進化したポイントは「制御性」にあります。

これまでのAI動画生成は、テキストを入力して結果を祈るような「ガチャ方式」に近い側面がありました。

Seedance 2.0では、画像・動画・音声の参照素材を最大12点まで同時に入力できる仕組みが実装されており、AIに対して「映画監督のような精密な演出指示」が可能になりました。

さらに、映像と音声を同時に生成する「ネイティブオーディオ生成」にも対応しており、フォーリー(効果音)・環境音・リップシンクを映像と完全に同期させた状態で出力できます。

ByteDanceは自社技術ブログ「Seed Research」の公式ローンチ発表において、Seedance 2.0について「テキスト・画像・音声・動画の4入力モダリティをサポートする統合型マルチモーダル音声映像同時生成アーキテクチャを採用し、業界で最も包括的なマルチモーダルコンテンツ参照・編集機能を実現した」と説明しています。また、内部ベンチマーク「SeedVideoBench-2.0」における評価では、複雑なマルチモーダルタスクを含む複数の次元でトップクラスの結果を達成したと公式に発表されています。

主な仕様と対応フォーマット

Seedance 2.0の主な仕様は以下のとおりです。

出力解像度は最大2K(標準1080p)で、動画の長さは4〜15秒(一部プラットフォームで最大20秒)に対応しています。

アスペクト比は16:9・9:16・4:3・3:4・21:9・1:1の6種類から選択可能で、縦型のSNSショートムービーから横型の映画的な映像まで幅広く対応しています。

サポートするビジュアルスタイルも豊富で、フォトリアル・アニメ・2D/3Dアニメーション・水彩・フィルムノワール・アブストラクトなど多彩なスタイルで出力が可能です。

リップシンクは英語・中国語・日本語・韓国語・スペイン語・インドネシア語を含む8言語以上に対応しています。

Seedance 2.0の使い方:アクセスとはじめ方

日本からアクセスできるプラットフォーム

Seedance 2.0は、ByteDanceが運営する複数のプラットフォームで利用できます。

ただし、2026年2月現在においてもグローバル展開は段階的に進められており、一部のプラットフォームは中国アカウントが必要なケースもあります。

日本からアクセスする場合の主な選択肢を整理します。

即夢AI(Jimeng AI)は、Seedance 2.0が最初に実装されたByteの公式クリエイティブプラットフォームです。最も機能が充実しており、Omni Referenceを含むマルチモーダル入力機能を完全な形で体験できます。新規ユーザーは1元(約20円)で7日間の試用が可能で、その後は有料プランへの移行が必要です。Seedance 2.0の全機能を使いたいなら、まずJimeng AIを試すことをおすすめします。

DreaminaはByteが開発した動画・画像特化のAIクリエイティブプラットフォームで、Seedanceモデルシリーズを早期統合しており、Webブラウザから比較的アクセスしやすいプラットフォームです。

DoubaoはByteの総合AIアシスタントアプリで、動画生成機能としてSeedance 2.0が統合されています。

ChatArtは複数のAIモデルを統合したオールインワンプラットフォームで、海外ユーザーでも中国アカウントなしでSeedance 2.0を利用できる選択肢として注目されています。

初めての動画生成:基本的な操作フロー

Seedance 2.0をはじめて触る場合は、最もシンプルな「テキスト→動画(Text-to-Video)」から始めることを強くすすめます。

基本的な手順は次の流れです。

- プラットフォームにアクセスしてログインし、動画生成画面を開く

- 「テキスト→動画」モードを選択する

- プロンプト(指示文)を入力フォームに書き込む

- 動画の長さとアスペクト比を選択する(はじめは5〜10秒・16:9がおすすめ)

- 解像度は最初の試行では標準画質で十分。モーションと構図が固まってから最終生成時に高画質へ切り替える

- 生成ボタンを押して結果を確認する

一度の生成結果だけで判断しないことが重要です。

2〜4個のバリエーションを生成して比較する習慣をつけることで、Seedance 2.0の特性をつかむスピードが大幅に上がります。

Seedance 2.0の使い方:Omni Reference機能を徹底解説

Omni Referenceとは何か?

Seedance 2.0の最大の差別化ポイントが、「Omni Reference(全方位リファレンス)」とも呼ばれるマルチモーダル参照機能です。

これは、テキストだけでなく画像・動画・音声のファイルを参照素材として入力し、生成映像の見た目・カメラワーク・キャラクター・音楽のリズムを精密にコントロールできる機能です。

具体的には、画像は最大9枚・動画は最大3本(合計15秒以内)・音声は最大3ファイル(合計15秒以内)を同時に参照素材として使用でき、合計12点のファイルを組み合わせることができます。

ポイントは「@メンション構文」です。ファイルをアップロードすると、モデルが自動的に @Image1・@Video1・@Audio1 のようなタグを割り当てます。このタグをプロンプト内で使って、各素材に「何の役割を担わせるか」を明示することで、AIへの指示精度が飛躍的に上がります。

@メンション構文の実践的な使い方

@メンション構文を使う際には、ただタグを記述するだけでなく「抽出してほしい要素」を明示的に書くことが重要です。

たとえば @Video1 とだけ書くよりも、Reference @Video1's camera movement(@Video1のカメラワークを参照する)と書く方が、意図したとおりの結果が得られやすくなります。

キャラクターの見た目を保つ:画像参照

自分のオリジナルキャラクターや特定の人物像を動画に登場させたい場合は、そのキャラクターの画像を @Image1 としてアップロードし、次のようにプロンプトを書きます。

The character from @Image1 walks slowly through a rainy city street. Camera slowly pushes in from medium shot. Cinematic lighting, film grain.

このように書くことで、アップロードした画像の外見・服装・顔の特徴を維持したまま動画を生成することができます。

⚠️ 著作権・肖像権に関するご注意

Omni Referenceに使用する参照素材の選択には注意が必要です。文化庁「AIと著作権に関する考え方について」では、AI生成物が既存の著作物と類似性・依拠性の両方を満たす場合、著作権侵害となり得ることが明示されています。

特に実在する人物の顔写真や、他者のキャラクターデザインを参照素材として使用することは、肖像権・著作権上のリスクが生じる可能性があります。Seedance 2.0を商用利用する際は、参照素材の権利関係を必ず確認したうえで使用してください。なお、ByteDance自身もリリース直後に著名人の肖像を複製するディープフェイク問題が発生したことを受け、実在人物参照機能に追加的な制限を設けた経緯があります。

カメラワークを転写する:動画参照

好みのカメラワークを使った映像をリファレンス動画としてアップロードし、そのカメラの動きを新しいシーンに適用することもできます。

A woman walking down a forest path in autumn. Reference @Video1's camera movement and rhythm.

このように書くことで、プロンプトだけでは細かく指示しにくい「ドリーショット」「オービット」「ヒッチコックズーム」といった映画的技法を、参照動画から直接転写することができます。

キャラクターの動きを転写する:モーション転写

@Image1 にキャラクター画像、@Video1 にダンスや特定の動作を収めた動画をアップロードして、次のように書きます。

@Image1 performs the dance from @Video1.

これにより、自分のオリジナルキャラクターに任意のモーションを「着せる」ことができる、非常に強力な使い方が実現します。

複数素材を組み合わせた高度なプロンプト

Omni Referenceの真価は、複数の参照素材を組み合わせたときに発揮されます。たとえば、キャラクター画像・背景画像・カメラワーク参照動画・BGM参照音声を同時にアップロードして次のように指示することができます。

The character from @Image1 stands in the environment from @Image2. Reference @Video1's camera movement. Background music references @Audio1's rhythm and mood.

これはまさに、映画監督がキャスト・ロケーション・カメラマン・音楽監督に同時に指示を出すような制作体験です。

Seedance 2.0の使い方:アニメ動画生成のコツ

なぜSeedance 2.0はアニメ生成に向いているか

Seedance 2.0 アニメ生成の品質が注目されている理由は、モデルが日本のアニメーション独特の表現要素(鮮やかな色彩・特徴的なキャラクター描写・ダイナミックな動き)を深く理解しているためです。

アニメスタイルの映像はフォトリアルな映像と異なる物理表現を持っており、AIモデルによっては不自然な崩れが起きやすいのですが、Seedance 2.0はスタイルの一貫性という点で高い評価を受けています。

データサイエンス教育プラットフォームのDataCampが実施した競合モデルとの比較検証によると、音声と映像の同期精度においてSeedance 2.0は競合モデルをわずかに上回ると評価されており、とくに「急速な動作変化を伴うシーンでの音声タイミングの正確性」において優位性が確認されています。また同検証では、アニメ・2D/3Dアニメーションを含む多彩なビジュアルスタイルに対応していることも確認されており、アニメ表現においても汎用性の高いモデルとして位置づけられています。

アニメ動画生成の基本プロンプト構成

アニメスタイルの動画を生成する際は、プロンプトの中でスタイルを明示的に指定することが重要です。

「anime style」や「Japanese anime aesthetic」「2D animation」といったキーワードを含めることで、モデルがアニメ表現に適した生成を行います。

以下は、アニメ少女が夏の森の中を歩くシーンの実践的なプロンプト例です。

An 18-year-old Japanese anime girl with short hair, wearing a white dress and straw hat, standing on a forest path in warm summer afternoon sunlight. She slowly turns toward the camera and smiles gently. A light breeze moves her hair and dress. The camera slowly pushes in from medium shot to close-up. Soft natural lighting, film grain, healing and peaceful mood, cinematic quality. Maintain face and clothing consistency, no distortion, high detail.

このプロンプトには、キャラクターの外見・シーンの状況・カメラワーク・スタイル・制約文(Maintain face and clothing consistency, no distortion, high detail)がすべて含まれています。

アニメ生成のスタイル指定バリエーション

アニメ動画のスタイルには、さらに細かい指定が可能です。目的に応じていくつかのスタイルキーワードを使い分けてみましょう。

ファンタジー系アニメを作りたい場合は Japanese fantasy anime style, vibrant colors, magical effects が有効です。

スタジオジブリのような柔らかい作品感を出したい場合は Ghibli-inspired animation style, hand-painted texture, warm watercolor lighting を使います。

バトルシーンなどアクション系には dynamic anime action scene, speed lines, dramatic lighting, intense motion が効果的です。

フィルムグレインと組み合わせることで、より映像としての質感が高まります。

キャラクターの一貫性を保つために

アニメ動画生成で特に重要なのが、キャラクターの顔・服装・全体デザインの一貫性です。

Seedance 2.0はキャラクターの一貫性保持において前世代から大幅に改善されていますが、プロンプトに制約文を必ず加えることが安定した品質への近道です。

すべてのアニメプロンプトの末尾には、次の制約文を加えることを強くおすすめします。

Maintain face and clothing consistency, no distortion, high detail. Character face stable without deformation, normal human structure, natural and smooth movements.

また、さらに画質を底上げする画質サフィックスも常に付加する習慣をつけましょう。

4K, Ultra HD, Rich details, Sharp clarity, Cinematic texture, Natural colors, Soft lighting, No blur, No ghosting, No flickering, Stable picture.

なお、Seedance 2.0は「ネガティブプロンプト(〜を避けてください)」に対応していない点に注意が必要です。「崩れた顔にしない」ではなく「Maintain face consistency(顔の一貫性を維持する)」のように、正向きの制約文として記述することがルールです。

プロが実践するプロンプト設計の基本テンプレート

汎用プロンプトのフレームワーク

Seedance 2.0で安定して高品質な動画を生成するために、毎回のプロンプトを次のフォーマットに沿って書くことを習慣にしましょう。

Subject(被写体)+ Action(動作)+ Setting(場所・環境)+ Lighting(照明)+ Camera Language(カメラワーク)+ Style(スタイル)+ Quality(画質)+ Constraints(制約)

Subject(被写体)

キャラクターや物体の外見を具体的に書きます。「女性」ではなく「ショートヘアで白いワンピースを着た20代の日本人女性」のように詳細に記述するほど、意図に近い結果が得られます。

Action(動作)

1つのプロンプト・1つのショットに対して、動作動詞は1つに絞ることが鉄則です。複数の動きを同時に指定するとモデルが混乱し、意図しない動作が生成されやすくなります。slowly turns toward the camera(ゆっくりカメラに向き直る)のように、シンプルで明確な動作を1つだけ指定しましょう。

Camera Language(カメラワーク)

Seedance 2.0はプロのカメラワーク語彙を理解します。ドリーイン(push in)・ドリーアウト(pull back)・オービット(orbiting shot)・クレーンショット(crane movement)・パン(pan left/right)・チルト(tilt up/down)などを直接テキストで指定できます。

より複雑なカメラワークを再現したい場合は、参照動画を使ったOmni Referenceが効果的です。

クリエイターが知っておきたいコツ

複数のバリエーションを比較して良いものを採用する「A/Bテスト的な使い方」が、Seedance 2.0を使いこなす最大のポイントです。

プロンプトを修正するときは、一度に複数の要素を変えないことが大切です。毎回1つの要素(スタイル・カメラワーク・照明など)だけを変えることで、どの変更が効果的だったかを正確に把握できます。

また、うまくいったプロンプトは「自分のプロンプトライブラリ」として記録しておくと、次回からの制作効率が格段に上がります。

Seedance 2.0のよくある失敗とその対策

キャラクターが崩れる・ブレる

アニメキャラクターの顔や体が途中で崩れてしまう場合は、制約文が不足しているか、登場キャラクターが多すぎることが原因の可能性があります。

Seedance 2.0は1〜2名のキャラクターを描写するのが安定します。3名以上になると、キャラクター間でアイデンティティが混同されるリスクが高まります。

プロンプトに応答してくれない

プロンプトが短すぎて情報が足りない場合と、長すぎてモデルが重要な部分を無視してしまう場合があります。

目安は30〜200語です。この範囲に収まるように情報を整理しましょう。

カメラワークが意図と違う

テキストで複雑なカメラワークを正確に伝えることには限界があります。こういった場合こそ、Omni ReferenceのVideo参照機能を活用しましょう。

意図したカメラワークに近い映像をリファレンス動画として用意し、Reference @Video1's camera movement and rhythm と指定することで、プロンプトだけでは難しい精度が実現します。

まとめ

Seedance 2.0の使い方について、基本操作からOmni Reference機能の詳細、アニメ動画生成のコツまで解説しました。

この記事の要点を整理します。

Seedance 2.0は画像・動画・音声を最大12点まで参照できるOmni Referenceのマルチモーダル機能が最大の特長で、AIに対して映画監督のような精密な演出指示ができます。

@Image1・@Video1・@Audio1のタグシステムを使いこなすことが、Omni Referenceを最大限に活用する鍵です。

アニメ生成では、スタイル指定・キャラクター一貫性制約文・画質サフィックスの3点セットをプロンプトに組み込む習慣が品質の安定に直結します。

プロンプト設計は「被写体・動作・環境・照明・カメラワーク・スタイル・画質・制約」の8要素を意識したフォーマットで書くことで、再現性が高まります。

一度の生成で諦めず、1点ずつ要素を変えながら複数バリエーションを比較する試行習慣が、Seedance 2.0を使いこなす最短ルートです。

Seedance 2.0はAI動画生成のパラダイムを「生成ツール」から「AI演出アシスタント」へと変える革新的なモデルです。Omni Referenceとプロンプト設計を組み合わせた制作スタイルを習得することで、あなたのクリエイティブな表現の可能性は大きく広がるでしょう。

※本記事に記載の仕様・対応プラットフォーム・料金体系は、2026年2月現在の情報をもとにしています。ByteDanceによるサービス展開は段階的に進行中であり、今後変更される場合があります。最新情報は各プラットフォームの公式サイトでご確認ください。

コメント